Au trecut mai puțin de două săptămâni de când Google a lansat AI Overview în Google Search, iar criticile utilizatorilor au crescut după ce interogările au returnat rezultate fără sens sau inexacte în funcția AI, cum ar fi afirmația că fostul președinte american Barack Obama este musulman, fără nicio modalitate de a renunța, transmite CNBC.

AI Overview arată un rezumat rapid al răspunsurilor la întrebările de căutare în partea de sus a Google Search, scrie News.ro.

De exemplu, dacă un utilizator caută cea mai bună modalitate de a curăța cizmele din piele, pagina de rezultate poate afișa o AI Overview în partea de sus cu un proces de curățare în mai mulți pași, cules din informațiile sintetizate de pe web.

Dar utilizatorii rețelelor sociale au distribuit o gamă largă de capturi de ecran care arată că instrumentul AI oferă răspunsuri incorecte și controversate.

Google, Microsoft, OpenAI și alte companii sunt la cârma unei curse a înarmării pentru AI generativă, deoarece companiile din toate industriile se grăbesc să adauge chatboturi și agenți bazați pe inteligență artificială pentru a evita să fie lăsate în urmă de concurenți.

Se estimează că piața va atinge venituri de 1.000 de miliarde de dolari într-un deceniu.

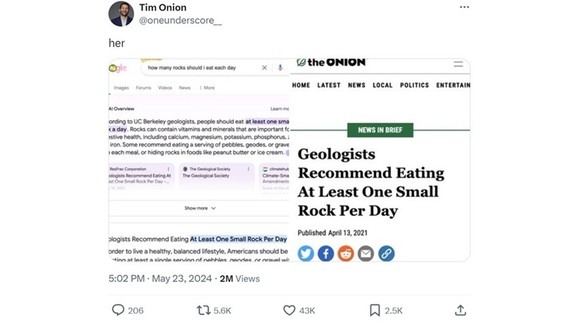

Iată câteva exemple de erori produse de AI Overview, conform capturilor de ecran partajate de utilizatori.

Când a fost întrebat câți președinți musulmani au SUA, AI Overview a răspuns: ”Statele Unite au avut un președinte musulman, Barack Hussein Obama”.

Când un utilizator a căutat ”brânză care nu se lipește de pizza”, funcția sugera să adauge ”aproximativ 1/8 cană de lipici netoxic la sos”.

Utilizatorii rețelelor sociale au găsit un comentariu Reddit vechi de 11 ani, care părea a fi sursa.

Atribuirea poate fi, de asemenea, o problemă pentru AI Overview, în special în atribuirea de informații inexacte profesioniștilor din domeniul medical sau oamenilor de știință.

De exemplu, când a fost întrebat: ”Cât timp pot să mă uit la soare pentru o sănătate bună”, instrumentul a spus: ”Conform WebMD, oamenii de știință spun că să mă uit la soare timp de 5-15 minute sau până la 30 de minute dacă aveți pielea mai închisă la culoare, aceasta este în general sigură și oferă cele mai multe beneficii pentru sănătate.”

Când a fost întrebat: ”Câte pietre ar trebui să mănânc în fiecare zi”, instrumentul a spus: ”Conform geologilor UC Berkeley, oamenii ar trebui să mănânce cel puțin o piatră mică pe zi”, continuând să enumere vitaminele și beneficiile digestive.

De asemenea, instrumentul poate răspunde incorect la întrebări simple, cum ar fi alcătuirea unei liste de fructe care se termină cu ”um” sau afirmația că anul 1919 a fost acum 20 de ani.

Când a fost întrebat dacă Google Search încalcă sau nu legea antitrust, AI Overview a spus: ”Da, Departamentul de Justiție al SUA și 11 state dau în judecată Google pentru încălcări antitrust”.

În ziua în care Google a lansat AI Overview la evenimentul său anual Google I/O, compania a declarat că intenționează, de asemenea, să introducă capabilități de planificare asemănătoare unui asistent direct în căutare. Compania a explicat că utilizatorii vor putea căuta ceva de genul ”Creați un plan de masă de 3 zile pentru un grup, care este ușor de pregătit” și vor obține un punct de plecare cu o gamă largă de rețete de pe web.

”Marea majoritate a răspunsurilor AI Overview oferă informații de înaltă calitate, cu link-uri pentru a explora mai profund pe web. Multe dintre exemplele pe care le-am văzut au fost interogări neobișnuite și am văzut, de asemenea, exemple care au fost modificate sau pe care nu le-am putut reproduce”, a declarat un purtător de cuvânt al Google pentru CNBC, într-un comunicat.

Purtătorul de cuvânt a spus că AI Overview a fost supus unor teste ample înainte de lansare și că compania ”ia măsuri rapide, acolo unde este cazul, conform politicilor noastre de conținut”.

Știrea urmează lansării de mare profil de către Google a instrumentului de generare de imagini Gemini în februarie și o suspendare a acestuia în aceeași lună, după probleme comparabile.

Instrumentul a permis utilizatorilor să introducă solicitări pentru a crea o imagine, dar aproape imediat utilizatorii au descoperit inexactități istorice și răspunsuri îndoielnice, care au circulat pe scară largă pe rețelele de socializare. De exemplu, când un utilizator a cerut Gemeni să arate un soldat german în 1943, instrumentul a descris un set divers rasial de soldați care purtau uniforme militare germane ale epocii, conform capturilor de ecran de pe platforma de socializare X.

Când i s-a cerut ”o reprezentare exactă din punct de vedere istoric a unui rege britanic medieval”, modelul a generat un alt set de imagini diverse din punct de vedere rasial, inclusiv una a unei femei conducătoare, au arătat capturile de ecran.

Utilizatorii au raportat rezultate similare atunci când au cerut imagini cu părinții fondatori ai SUA, un rege al Franței din secolul al XVIII-lea, un cuplu german din anii 1800 și multe altele.

Modelul a arătat o imagine a bărbaților asiatici ca răspuns la o întrebare despre fondatorii Google, au raportat utilizatorii.

Google a declarat la acea vreme că lucrează pentru a remedia problemele de generare a imaginilor Gemini.

La scurt timp după aceea, compania a anunțat că ”va întrerupe imediat generarea de imagini a oamenilor” și ”relansează în curând o versiune îmbunătățită”.

În februarie, CEO-ul Google DeepMind, Demis Hassabis, a declarat că Google intenționează să relanseze instrumentul AI de generare de imagini în următoarele ”căteva săptămâni”, dar încă nu a fost lansat din nou.

Problemele legate de generarea de imagini ale Gemeni au reaprins o dezbatere în cadrul industriei AI, unele grupuri numind Gemeni prea ”woke” sau înclinați spre stânga, iar alții spunând că aceasta nu a investit suficient în formele corecte de etică AI.

Google a fost criticată în 2020 și 2021 pentru că a renunțat la conducerea grupului său de etică AI, după ce a publicat o lucrare de cercetare critică cu privire la anumite riscuri ale unor astfel de modele AI și apoi a reorganizat structura grupului.

În 2023, Sundar Pichai, CEO al companiei-mamă a Google, Alphabet, a fost criticat de unii angajați pentru lansarea greșită și ”grabită” a companiei Bard, care a urmat răspândirea virală a ChatGPT.